Évaluer l'IA coûte désormais plus cher que l'entraîner

Pourquoi ça compte pour toi

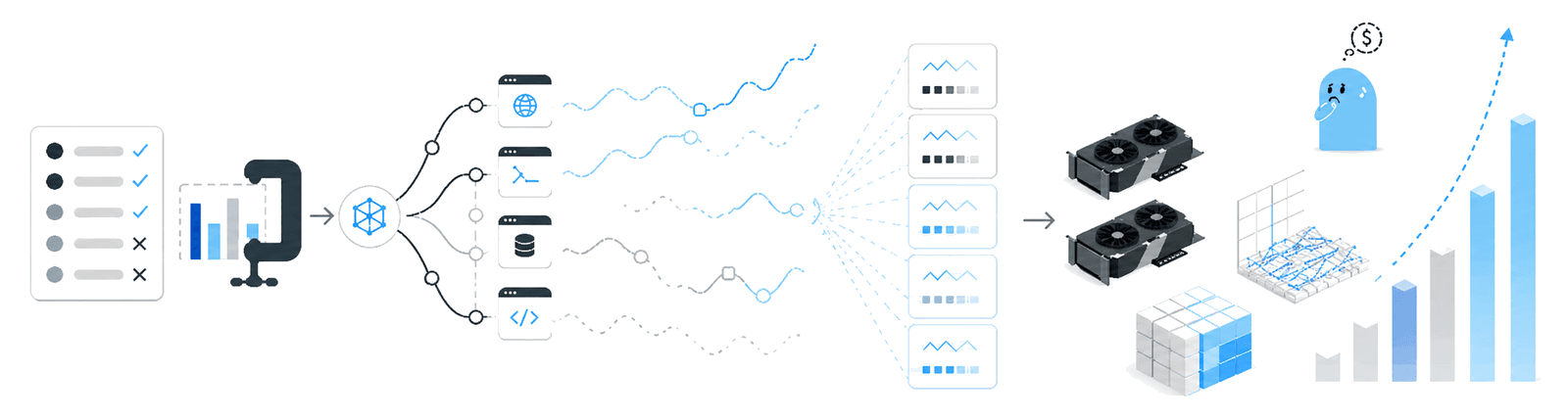

Si tu développes des modèles ou des agents IA, tu vas buter sur un mur : tester coûte parfois 10× plus cher que créer. Les benchmarks deviennent inaccessibles aux petits labs. Et contrairement aux anciennes techniques de compression, les agents IA résistent aux raccourcis — chaque test est une tentative multiple et coûteuse.

Ce qu'il faut retenir

- 1.Évaluer 21k rollouts d'agents IA sur 9 benchmarks = $40k ; une seule exécution GAIA frontier model = $2,8k

- 2.Les modèles haut de gamme (Claude Opus vs Gemini 2.0) affichent des écarts de prix de 150× sur les tokens d'input

- 3.Un même agent peut coûter 9× plus cher qu'un concurrent pour 2% de différence de précision

- 4.La compression classique (gains de 100× à 200× sur les benchmarks statiques) ne fonctionne que partiellement sur les agents

- 5.En recherche scientifique ML, évaluer coûte 100× plus cher que l'entraînement — un paradigme nouveau

Pourquoi ça coûte soudain une fortune ?

Jusqu'à récemment, évaluer un modèle revenait à faire tourner des benchmarks statiques (HELM, MMLU, etc.). Pas gratuit, mais compressible. Stanford l'a montré en 2022 : en réduisant HELM de 100× à 200×, les classements restaient identiques. Les chercheurs ont vite compris l'astuce : les modèles ne divergent que sur une petite fraction des items, donc on peut sous-échantillonner agressivement.

Cette astuce a volé en éclats avec les agents.

L'agent change la donne : chaque évaluation est un parcours complet

Quand tu évalues un modèle seul, tu mesures sa performance sur un texte. Quand tu évalues un agent, tu mesures sa capacité à naviguer le web, coder, répondre à des questions en plusieurs étapes. Chaque tentative implique plusieurs appels API, plusieurs chaînes de tokens, souvent des essais et des erreurs. Et c'est bruité : une même tâche avec Claude Sonnet 4 coûte $1,577 pour 40% de succès ; avec GPT-5 Medium, $171 pour 42%. Neuf fois plus cher pour deux points d'exactitude.

Pire : ce n'est pas seulement le modèle que tu testes. C'est le modèle × le scaffolding × le budget de tokens. Changer la façon dont tu instruis l'agent peut multiplier les coûts par 10×.

Les prix des modèles s'envolent aussi

Claude Opus 4.1 : $15 par million de tokens d'input, $75 pour l'output. Gemini 2.0 Flash : $0.10 et $0.40.

Deux ordres de magnitude d'écart sur l'input seul. Évaluer le même agent sur Claude plutôt que sur Gemini, c'est changer complètement ton budget.

Les anciennes techniques de compression ne suffisent plus

Un chercheur a testé un filtre simple : ne conserver que les tâches affichant un taux de réussite historique compris entre 30 et 70%. Résultat : une réduction de 2× à 3,5×. Utile, mais loin des 100× à 200× obtenus sur les benchmarks statiques. La raison : chaque item d'évaluation d'agent est une expérience multi-tour avec sa propre variance. On ne peut pas éliminer 99% des données et espérer que ça tienne.

En recherche scientifique ML, c'est l'inversion complète

The Well (benchmark SciML) illustre l'extrême. Évaluer une nouvelle architecture demande 960 heures d'H100. L'entraîner ? Une douzaine d'heures. L'évaluation représente ici 80 entraînements de référence. Dans ce coin du ML, évaluer coûte ~100× plus que l'entraînement. L'ancien paradigme — l'entraînement comme goulot d'étranglement — s'est inversé.

Source

Pour aller plus loin

Cet article t'a donné envie d'approfondir ? Deux formations Noésis t'attendent :

Explorer les thèmes de cet article :