Token

Définition

Un token est la plus petite unité de texte qu'une IA peut traiter. C'est un mot, une partie de mot ou un caractère spécial. Les modèles comptent les tokens pour fonctionner et facturer : une phrase de 10 mots fait environ 12-15 tokens.

Quand tu envoies "Bonjour, comment ça va ?" à ChatGPT, il le découpe en 6-8 tokens avant de répondre, et tu paies selon ce nombre.

Comprendre les tokens te permet d'estimer les coûts réels, d'optimiser tes prompts, et de savoir combien d'histoire l'IA peut vraiment "lire" en une fois.

Voir aussi

Articles qui en parlent

Les goulets d'étranglement de l'IA : ce que les patrons veulent vraiment dire

Les géants de l'IA manquent déjà de puces et d'électricité. Et ce n'est que le début des problèmes.

Specsmaxxing : quand les specs sauvent ton IA de la folie

Écrire des specs structurées en YAML, c'est comment transformer tes agents IA en vrais développeurs au lieu de générateurs de slop.

GitGres : ton GitHub privé sur PostgreSQL

Reprendre le contrôle total de tes dépôts Git : GitGres te laisse héberger ton propre GitHub sur PostgreSQL.

Codex CLI peut enfin boucler jusqu'à son objectif

Codex CLI 0.128.0 lance /goal : tu dis au code ce que tu veux, il boucle jusqu'à réussir.

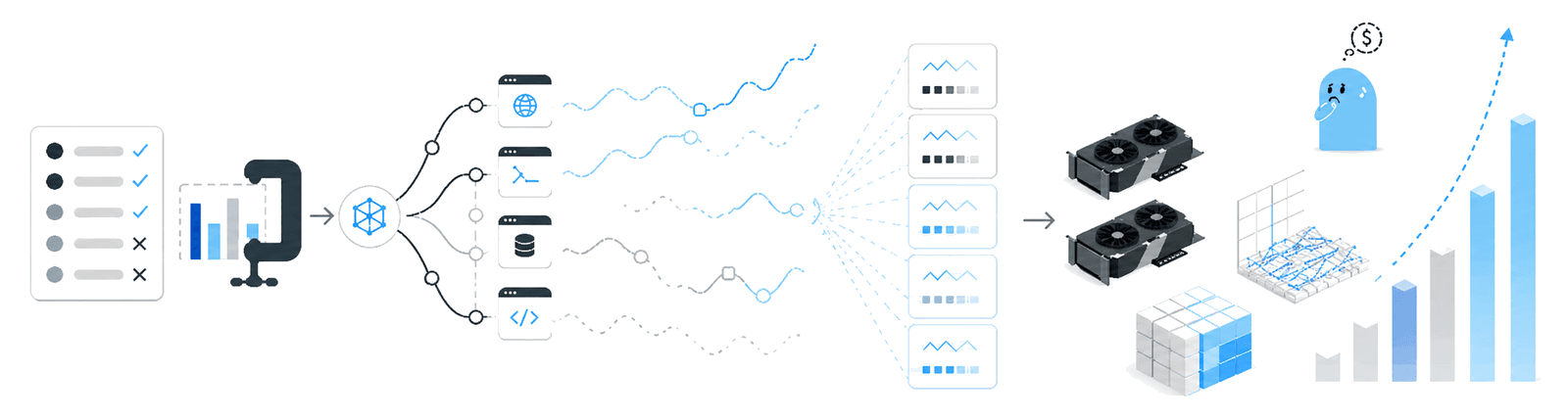

Évaluer l'IA coûte désormais plus cher que l'entraîner

L'évaluation des modèles IA est devenue si chère qu'elle redéfinit qui peut faire de la recherche.

Nemotron, Laguna, vLLM 0.20 : la semaine qui change les infras

Trois lancements qui redéfinissent comment faire tourner l'IA en production : modèles omni, kernels plus rapides, orchestration d'agents.